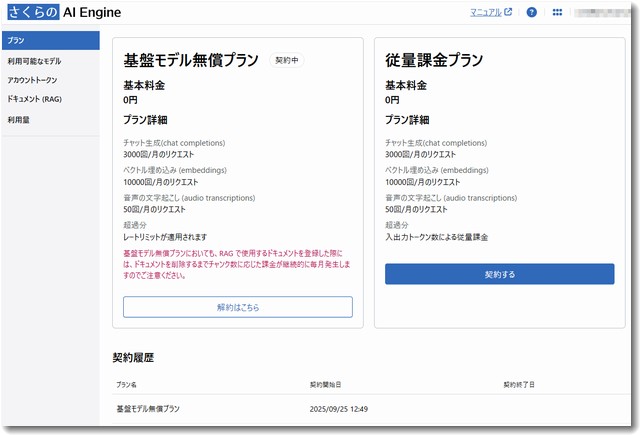

2025年9月24日、さくらインターネットが、生成AI向けの新サービス「さくらのAI Engine」の一般提供を開始しました。このニュースはX(旧Twitter)で同社の田中社長が告知、特に「月3,000回まで無料で使える無償プラン」があることで大きな話題を呼んでいます。

2025年9月24日、さくらインターネットが、生成AI向けの新サービス「さくらのAI Engine」の一般提供を開始しました。このニュースはX(旧Twitter)で同社の田中社長が告知、特に「月3,000回まで無料で使える無償プラン」があることで大きな話題を呼んでいます。

自社のサービスにAIを組み込みたい開発者から、最新のAIを手軽に試してみたい初心者まで、すべての人にチャンス到来です。

政府も使う国内サーバーだから安心なAI環境です

「高性能なAIって、使うのが難しいんじゃないの?」「結局お金がかかるんでしょ?」と思っていた方もご安心ください。無料で使えます。しかも、政府も使うガバクラ(ガバメントクラウド)として有名なさくらインターネットのAIサービスなので安心です。

オープンソースで最強のChatGPTと言われている「gpt-oss-120b」が使えるんです。しかもエヌビディアのGPUが入っている国内サーバーで。これが無料で使えるなんてすごいですよね。

この記事では、さくらのAI Engineの登録方法から、プログラミング知識がなくても使える簡単な方法、そして開発者向けのAPIとしての使い方まで、レベルに合わせて解説します。

🚀 まずは会員登録!3分で終わる初期設定

AI Engineを使い始めるための最初のステップは、利用登録です。さくらインターネットの会員IDがあればすぐに始められます。

- 公式サイトにアクセス まずは、さくらのAI Engine 公式ページにアクセスし、「お申し込み」ボタンをクリックします。

- 会員IDでログイン さくらインターネットの会員IDとパスワードでログインします。もしまだIDを持っていない場合は、この機会に新規登録(無料)しましょう。

- AI Engineの利用開始手続き ログイン後、コントロールパネルから「さくらのAI Engine」を選択し、利用規約に同意して初期登録を完了させます。手続きは非常にシンプルで、画面の指示に従うだけですぐに終わります。基盤モデル無償プランでスタートするのがよいです。

- 重要!APIキーとエンドポイントを控える 登録が完了すると、管理画面で「APIキー(トークン)」と「エンドポイントURL」が発行されます。

- APIキー: あなた専用の「パスワード」のようなものです。

- エンドポイントURL: AIと通信するための「専用の住所」です。

この2つの情報は、AI Engineを使う上で必ず必要になるので、コピーしてメモ帳などに大切に保管しておきましょう。

gpt-oss-120bを使う場合のAPIエンドポイントURL: https://api.ai.sakura.ad.jp/v1/chat/completions

アカウントトークンID 24****fa-****-****-****-586****f2d06

アカウントトークン名 aisakura123

💻 さくらのAI Engineを使ってみよう!2つの方法

APIキーとエンドポイントURLが手に入れば、いよいよAIを実際に使う準備が整いました。使い方は大きく分けて2通りあります。

方法1:あなた専用のチャットサイトを作る(プログラミング不要の簡単モード)

「APIって言われてもよくわからない…」という方に最もおすすめなのが、あなた専用のAIチャットサイトをインターネット上に作る方法です。

これは「Chatbot UI」という無料のソフトウェアを、「Vercel」という無料のウェブサイト公開サービスを使って設置するもので、クリック中心の作業で完了します。

【準備するもの】

- GitHubアカウント: まだ持っていない場合は公式サイトから無料で作成してください。

- さくらの「APIキー」と「エンドポイントURL」

【設定手順】

- Vercelに登録する Vercelの公式サイトにアクセスし、「Sign Up」ボタンから進みます。登録方法を聞かれたら**「Continue with GitHub」**を選び、準備したGitHubアカウントで連携・登録します。

- Chatbot UIのテンプレートをコピーする 下のリンクをクリックして、Chatbot UIのVercel用テンプレートページを開きます。

- Chatbot UI テンプレートページ: https://vercel.com/templates/next.js/chatbot-ui

- サイトを自動で構築(デプロイ)する ページが開いたら**「Deploy」**ボタンをクリック。次の画面でリポジトリ名(サイトの設計図の名前)を自由につけて「Create」を押します。

- さくらのAI Engineと接続する【最重要】 サイト構築の設定画面で「環境変数(Environment Variables)」の入力を求められます。ここで、さくらのAIの情報を入力します。

OPENAI_API_KEYという欄に、さくらで取得した**『APIキー』**を貼り付けます。OPENAI_API_HOSTという欄に、さくらで取得した**『エンドポイントURL』**を貼り付けます。- 入力が終わったら「Deploy」ボタンを押します。

数分待つと、あなた専用のチャットサイトが完成します!表示されたURL(〇〇.vercel.appのようなアドレス)をブックマークすれば、いつでもそのサイトにアクセスして、さくらインターネットのAIとチャットができるようになります。

方法2:APIとして他のサービスで使う(開発者向けモード)

正直に告白すると、私自身にこのAPIを使って何か新しいサービスをゼロから開発するほどのスキルはありません。ですが、これが開発者の方々にとってどれほど強力なツールであるかは、調べてみてよく分かりました。

自社のウェブサービスやアプリケーションにAI機能を組み込みたい開発者の方は、APIとして直接利用します。さくらのAI Engineは、OpenAIのAPIと互換性があるため、既存のライブラリやツールをそのまま流用できるのが最大のメリットです。

例えば、Pythonで簡単なチャット応答を実装する場合、以下のようなコードになります。

Python

# openaiライブラリをインストールしておく必要があります

# pip install openai

from openai import OpenAI

# さくらのAI Engineから取得した情報を設定

SAKURA_API_KEY = “ここにあなたのAPIキーを貼り付け”

SAKURA_BASE_URL = “ここにあなたのエンドポイントURLを貼り付け”

client = OpenAI(

api_key=SAKURA_API_KEY,

base_url=SAKURA_BASE_URL,

)

# チャットの実行

chat_completion = client.chat.completions.create(

messages=[

{

“role”: “user”,

“content”: “さくらインターネットのAI Engineについて教えてください。”,

}

],

model=”gpt-oss-120b”, # 利用したいモデル名を指定

)

# 結果の表示

print(chat_completion.choices[0].message.content)

このように、api_keyとbase_urlを書き換えるだけで、既存のOpenAI向けコードがさくらのAI Engineに接続できます。国内サーバーで完結するため、セキュリティやデータプライバシーを重視する日本のビジネスに最適です。

なお、LMスタジオで使う方法はうまくいきませんでした

PCにインストールしてあるLMスタジオとさくらインターネットのAIサービスを接続して使う方法があるという情報があったので試してみました。

しかし、私の環境ではどうにもうまくいきませんでした。これがうまくいけば、LMスタジオで「さくらAIのgpt-oss-120b」を駆動できたはずです。この件に関しては後日、再チャレンジをしてみたいと思います。

以下は参考情報です。(備忘録としておいておきます)

LM Studioで、さくらインターネットAIを使う設定方法

- LM Studio(すでにインストール済み)

- さくらインターネットの「APIキー」「エンドポイントURL」

- これは以前の手順で取得したものです。もしわからなければ、さくらインターネットの管理画面(コントロールパネル)で確認できます。

設定手順

ステップ1:LM Studioの「ローカルサーバー」機能を起動する

- まず、LM Studioを起動します。

- 画面左側にあるメニューアイコンの中から、「⇔」のような形のアイコン(Local Server)をクリックします。

- この画面で、さくらインターネットのAIと通信するための中継サーバーを起動します。

ステップ2:外部のAIモデルを設定する

- サーバー画面の上部にある**「External Model」タブ、または「Add Remote Model」**といったボタンを探してクリックします。

- 「Add a new external model」という設定画面が開きます。ここに、さくらインターネットのAIの情報を入力していきます。

- Model ID / Name: 識別しやすい名前を自由につけます。(例:

sakura-ai-120b) - Connection String / Base URL: ここに、さくらインターネットの**『エンドポイントURL』**を貼り付けます。

- API Key: ここに、さくらインターネットの**『APIキー』**を貼り付けます。

- Model ID / Name: 識別しやすい名前を自由につけます。(例:

- 入力が終わったら、「Add Model」や「Save」といったボタンを押して設定を保存します。

ステップ3:チャット画面でAIを呼び出す

- 設定が完了したら、LM Studioのメイン機能であるチャット画面に戻ります。画面左側のメニューから吹き出しのアイコン(Chat)をクリックします。

- チャット画面の上部(または右側)に、使用するAIモデルを選択するプルダウンメニューがあります。

- そこをクリックし、リストの中から先ほど自分で名前をつけたモデル(例:

sakura-ai-120b)を選択します。 - これで準備は完了です。あとはいつも通り、チャット入力欄に質問や指示を打ち込むだけです。LM Studioの画面を使いながら、実際の計算はさくらインターネットのパワフルなサーバーが行ってくれるようになります。

この方法のメリット

- 使い慣れた画面: 新しいアプリの操作を覚える必要がありません。

- PCに負荷ゼロ: モデル(AI)自体はPC上で動かないため、PCが重くなることはありません。

- モデル管理が不要: ローカルAIのように、大きなモデルファイルをダウンロードしたり管理したりする必要がありません。

この設定を行えば、現在お使いのローカルAI(gpt-20b)と、さくらインターネットの高性能なAI(gpt-oss-120b)を、同じLM Studioの画面からいつでも切り替えて使えるようになります。

…というGeminiの解説どおりにやってみました。この方法は、現在うまくできていません。残念。後日あらためて時間があるときにチャレンジしてみたいです。

自分のPCで快適に使う方法はLobeChat活用

自分のPCでオープンソースのAIを快適に使うにはLobeChatを活用して、さくらのAIに接続する方法がよいことがわかりました。この設定がうまくできると快適に「さくらAIのgpt-oss-120b」が使えます。爆速になりました。

この記事を書いた遠田幹雄は中小企業診断士です

遠田幹雄は経営コンサルティング企業の株式会社ドモドモコーポレーション代表取締役。石川県かほく市に本社があり金沢市を中心とした北陸三県を主な活動エリアとする経営コンサルタントです。

小規模事業者や中小企業を対象として、経営戦略立案とその後の実行支援、商品開発、販路拡大、マーケティング、ブランド構築等に係る総合的なコンサルティング活動を展開しています。実際にはWEBマーケティングやIT系のご依頼が多いです。

民民での直接契約を中心としていますが、商工三団体などの支援機関が主催するセミナー講師を年間数十回担当したり、支援機関の専門家派遣や中小企業基盤整備機構の経営窓口相談に対応したりもしています。

保有資格:中小企業診断士、情報処理技術者など

会社概要およびプロフィールは株式会社ドモドモコーポレーションの会社案内にて紹介していますので興味ある方はご覧ください。

お問い合わせは電話ではなくお問い合わせフォームからメールにておねがいします。新規の電話番号からの電話は受信しないことにしていますのでご了承ください。

【反応していただけると喜びます(笑)】

記事内容が役にたったとか共感したとかで、なにか反応をしたいという場合はTwitterやフェイスブックなどのSNSで反応いただけるとうれしいです。

本日の段階で当サイトのブログ記事数は 7,030 件になりました。できるだけ毎日更新しようとしています。

遠田幹雄が利用しているSNSは以下のとおりです。

facebook https://www.facebook.com/tohdamikio

ツイッター https://twitter.com/tohdamikio

LINE https://lin.ee/igN7saM

チャットワーク https://www.chatwork.com/tohda

また、投げ銭システムも用意しましたのでお気持ちがあればクレジット決済などでもお支払いいただけます。

※投げ銭はスクエアの「寄付」というシステムに変更しています(2025年1月6日)

※投げ銭は100円からOKです。シャレですので笑ってご支援いただけるとうれしいです(笑)

株式会社ドモドモコーポレーション

石川県かほく市木津ロ64-1 〒929-1171

電話 076-285-8058(通常はFAXになっています)

IP電話:050-3578-5060(留守録あり)

問合→メールフォームからお願いします

法人番号 9220001017731

適格請求書(インボイス)番号 T9220001017731

英語表示の社名:DomoDomo Corporation Inc.